زیرساخت هوش مصنوعی انویدیا NVIDIA DGX A100 640GB

سیستم جهانی زیرساخت هوش مصنوعی

چالش مقیاسپذیری هوش مصنوعی سازمانی

هر کسب و کاری باید با استفاده از هوش مصنوعی (AI) متحول شود، نه تنها برای بقا، بلکه برای پیشرفت در زمان های چالش برانگیز.

با این حال، این شرکت به یک پلتفرم برای زیرساخت هوش مصنوعی نیاز دارد که بر اساس رویکردهای سنتی بهبود یابد، که از لحاظ تاریخی شامل معماریهای محاسباتی کندی میشد که توسط تحلیل، آموزش، و حجم کاری استنتاج حذف میشدند.

رویکرد قدیمی پیچیدگی ایجاد کرد، هزینه ها را افزایش داد، سرعت مقیاس را محدود کرد و برای هوش مصنوعی مدرن آماده نبود.

شرکت ها، توسعه دهندگان، دانشمندان داده و محققان به یک پلت فرم جدید نیاز دارند که تمام بارهای کاری هوش مصنوعی را یکپارچه کند، زیرساخت ها را ساده کند و بازگشت سرمایه را تسریع کند.

سیستم جهانی برای هر بار کاری هوش مصنوعی

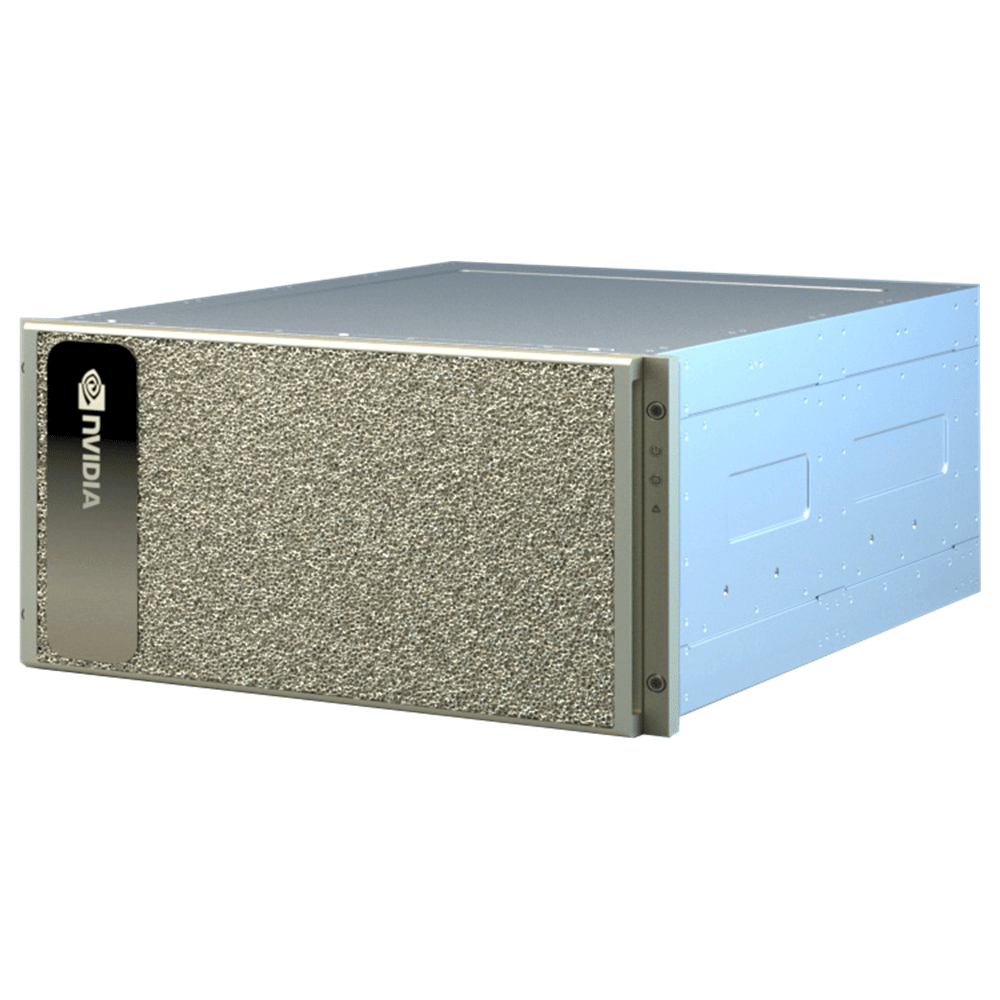

NVIDIA DGX A100 که بخشی از پلتفرم NVIDIA DGX™ است، سیستم جهانی برای همه بارهای کاری هوش مصنوعی است – از تجزیه و تحلیل گرفته تا آموزش تا استنتاج.

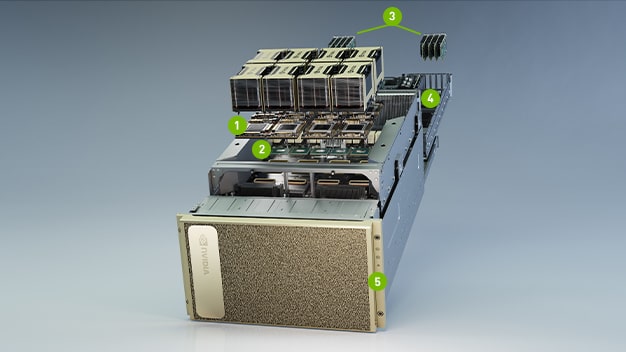

DGX A100 نوار جدیدی را برای تراکم محاسباتی تعیین می کند، و 5 پتافلاپ از عملکرد هوش مصنوعی را در یک فرم فاکتور 6U قرار می دهد و زیرساخت محاسباتی قدیمی را با یک سیستم واحد و یکپارچه جایگزین می کند.

DGX A100 همچنین توانایی بیسابقهای برای ارائه تخصیص دقیق قدرت محاسباتی، با استفاده از قابلیت GPU چند نمونهای (MIG) در NVIDIA A100 Tensor Core GPU ارائه میدهد. این به مدیران امکان میدهد منابعی را با اندازه مناسب برای بارهای کاری خاص اختصاص دهند

DGX A100 با حداکثر 640 گیگابایت حافظه GPU موجود است که عملکرد را در کارهای آموزشی در مقیاس بزرگ تا 3 برابر افزایش می دهد و اندازه نمونه های MIG را دو برابر می کند، DGX A100 می تواند بزرگترین و پیچیده ترین کارها را به همراه ساده ترین و کوچکترین این ترکیبی از توان محاسباتی متراکم و انعطافپذیری کامل حجم کار، DGX A100 را به گزینهای ایدهآل برای استقرار DGX تک و مقیاسشده تبدیل میکند.

هر سیستم DGX توسط NVIDIA Base Command™ برای مدیریت تک نود و همچنین خوشههای Slurm یا Kubernetes در مقیاس بزرگ تامین میشود و شامل مجموعه NVIDIA AI Enterprise از کانتینرهای نرمافزار هوش مصنوعی بهینهشده است.

سطح بی نظیر پشتیبانی و تخصص

NVIDIA DGX A100 چیزی فراتر از یک سرور است. این یک پلتفرم سختافزاری و نرمافزاری کامل است که بر اساس دانش بهدستآمده از بزرگترین مرکز آزمایش DGX جهان – NVIDIA DGX SATURNV – و توسط هزاران DGXperts در NVIDIA پشتیبانی میشود.

DGXperts متخصصانی مسلط به هوش مصنوعی هستند که در دهه گذشته دانش و تجربه زیادی را برای کمک به به حداکثر رساندن ارزش سرمایه گذاری DGX ایجاد کرده اند.

DGXperts کمک می کند تا اطمینان حاصل شود که برنامه های کاربردی حیاتی به سرعت راه اندازی و اجرا می شوند، و به آرامی در حال اجرا می مانند تا زمان بینش به طرز چشمگیری بهبود یابد.

سریعترین زمان برای حل مسائل

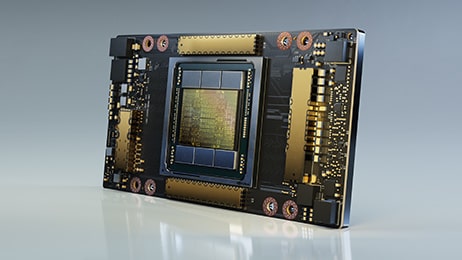

NVIDIA DGX A100 دارای هشت پردازنده گرافیکی NVIDIA A100 Tensor Core است که شتاب بینظیری را ارائه میکنند و کاملاً برای نرمافزار NVIDIA CUDA-X™ و مجموعه راهحل مرکز داده NVIDIA بهینه شده است. پردازندههای گرافیکی NVIDIA A100 دقت Tensor Float 32 (TF32) را به ارمغان میآورند که فرمت دقیق پیشفرض برای چارچوبهای TensorFlow و PyTorch AI است. این درست مانند FP32 عمل می کند، اما 20 برابر عملیات شناور بالاتر در ثانیه (FLOPS) را برای هوش مصنوعی نسبت به نسل قبلی ارائه می دهد. بهتر از همه، هیچ تغییر کدی برای دستیابی به این سرعت لازم نیست.

GPU A100 80GB پهنای باند حافظه GPU را 30 درصد نسبت به A100 40GB GPU افزایش می دهد و با 2 ترابایت در ثانیه اولین در جهان است.

همچنین دارای حافظه روی تراشه بسیار بیشتری نسبت به نسل قبلی پردازنده گرافیکی NVIDIA است، از جمله حافظه نهان سطح 2 با ظرفیت 40 مگابایت (MB) که تقریباً 7 برابر بزرگتر است و عملکرد محاسباتی را به حداکثر می رساند.

DGX A100 همچنین نسل سوم NVIDIA® NVLink® را معرفی کرد که پهنای باند مستقیم GPU به GPU را به 600 گیگابایت در ثانیه (GB/s) دوبرابر میکند، تقریباً 10 برابر بیشتر از PCIe Gen 4، و NVIDIA NVSwitch™ که 2 برابر سریعتر است.

نسبت به نسل گذشته این قدرت بیسابقه سریعترین زمان را برای راهحل ارائه میدهد و به کاربران اجازه میدهد تا با چالشهایی که قبلاً ممکن یا عملی نبودند، مقابله کنند.

زیرساخت هوش مصنوعی انویدیا NVIDIA DGX A100 640GB

امن ترین سیستم هوش مصنوعی جهان برای سازمانی

NVIDIA DGX A100 با رویکردی چندلایه که تمامی قطعات اصلی سخت افزار و نرم افزار را ایمن می کند، وضعیت امنیتی قوی را برای شرکت های هوش مصنوعی ارائه می دهد. DGX A100 با گسترش کنترلکننده مدیریت پایه (BMC)، برد CPU، برد GPU و درایوهای رمزگذاریشده خودکار، دارای امنیت داخلی است که به فناوری اطلاعات اجازه میدهد به جای صرف زمان برای ارزیابی و کاهش تهدید، روی عملیاتی کردن هوش مصنوعی تمرکز کند.

مقیاس پذیری بی نظیر مرکز داده با شبکه NVIDIA

NVIDIA DGX A100 با سریعترین معماری ورودی/خروجی (IO) در بین هر سیستم DGX، بلوک اساسی برای ابررایانههای هوش مصنوعی در مقیاس بزرگ مانند NVIDIA DGX Cloud و NVIDIA DGX SuperPOD™ است.

DGX A100 دارای حداکثر هشت آداپتور تک پورت NVIDIA ConnectX®-6 یا ConnectX-7 برای خوشه بندی و حداکثر دو آداپتور ConnectX-6 یا ConnectX-7 دو پورت برای ذخیره سازی و شبکه است که همگی قادر به انتقال با سرعت 200 گیگابیت بر ثانیه هستند.

با اتصال ConnectX-7 به سوئیچهای NVIDIA Quantum-2 InfiniBand، DGX SuperPOD را میتوان با سوئیچها و کابلهای کمتری ساخت و در زیرساخت مرکز داده صرفهجویی در capex و opex ایجاد کرد.

ترکیبی از محاسبات عظیم با شتاب GPU با پیشرفتهترین سختافزار شبکه و بهینهسازیهای نرمافزاری به این معنی است که DGX A100 میتواند به صدها یا هزاران گره برای مقابله با بزرگترین چالشها، مانند هوش مصنوعی مکالمه و طبقهبندی تصاویر در مقیاس بزرگ مقیاس شود.

راه حل های زیرساختی اثبات شده ساخته شده با رهبران مرکز داده قابل اعتماد

در ترکیب با ارائه دهندگان پیشرو فناوری ذخیره سازی و شبکه، مجموعه ای از راه حل های زیرساختی موجود است که بهترین معماری مرجع NVIDIA DGX BasePOD™ را در خود جای داده است. این راه حل ها که به عنوان پیشنهادات کاملاً یکپارچه و آماده برای استقرار از طریق شبکه شریک NVIDIA (NPN) ارائه می شوند، استقرار هوش مصنوعی مرکز داده را ساده و تسریع می کنند.

زیرساخت هوش مصنوعی انویدیا NVIDIA DGX A100 640GB

- 8X NVIDIA A100 GPUS WITH UP TO 640 GB TOTAL GPU MEMORY

- 6X NVIDIA NVSWITCHES

- 10x MELLANOX CONNECTX-6 200Gb/S NETWORK INTERFACE

- DUAL 64-CORE AMD CPUs AND UP TO 2 TB SYSTEM MEMORY

- Up to 30 TB GEN4 NVME SSD

مشخصات محصول در وبسایت رسمی سازنده

ترجمه اختصاصی از اس اس دی بازار

نقد و بررسیها

هیچ دیدگاهی برای این محصول نوشته نشده است.